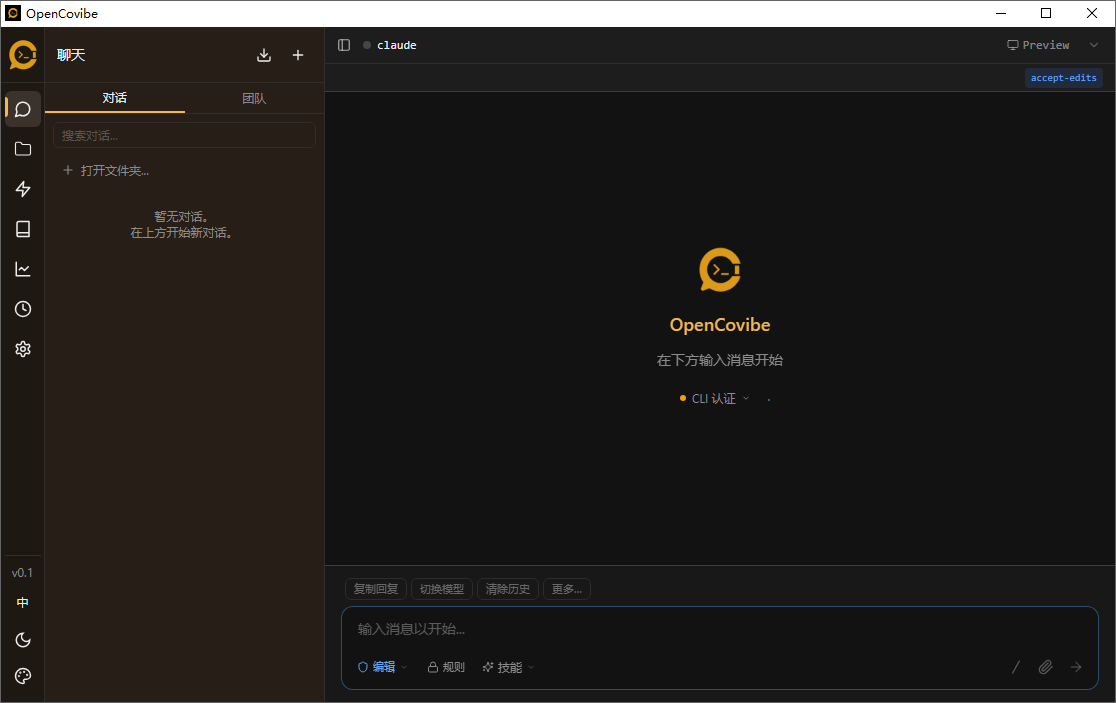

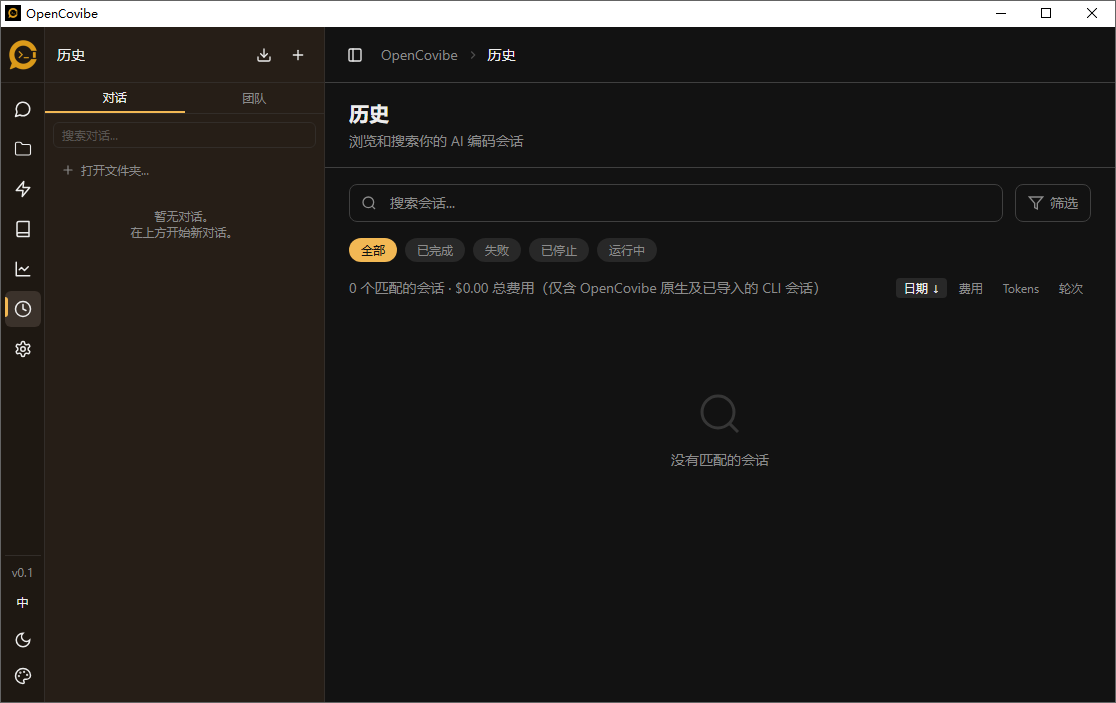

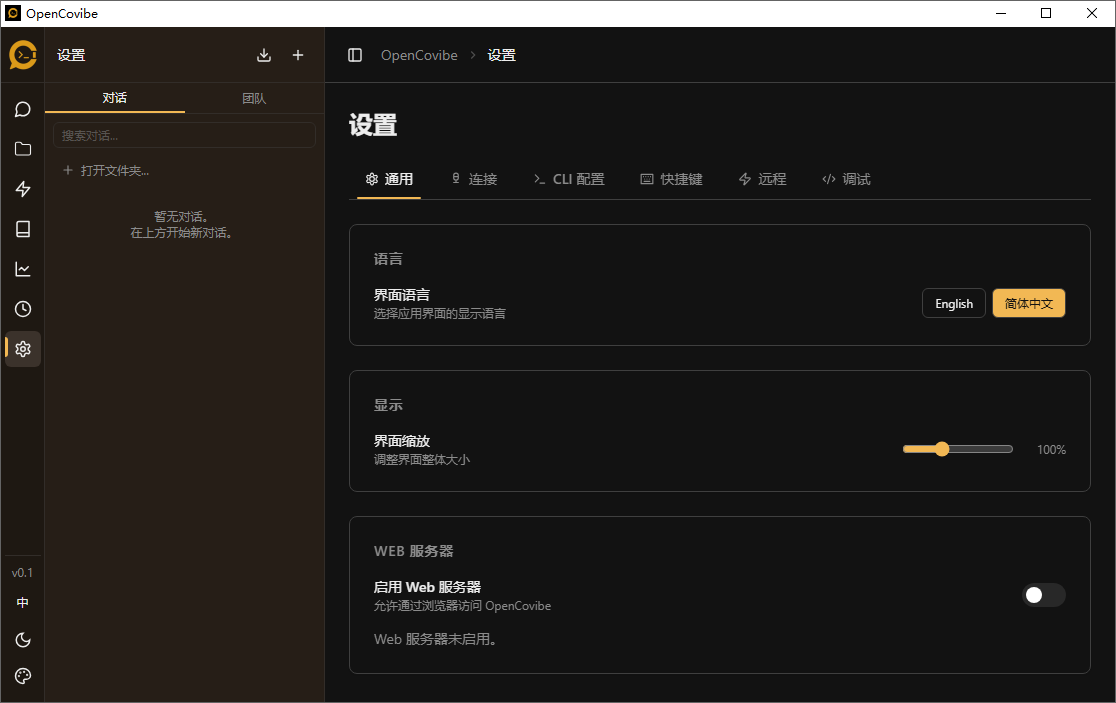

软件截图

软件介绍

OpenCovibe 是一款基于 Tauri v2 与 Svelte 5 构建的“本地优先(Local-first)”桌面端 AI 编程代理应用程序。其核心设计理念是为 Claude Code、Codex 等原先仅能在终端(Terminal)中运行的 AI 编程命令行工具(CLI)穿上一层现代化的图形交互外衣。它不仅填补了纯命令行在会话持久化、多模型自由切换以及复杂代码差异可视化(Diff Review)上的体验空白,更确保了所有用户配置和运行数据完全驻留本地设备,在提供原生应用般丝滑体验的同时,兼顾了极客对开发效率的追求与对代码隐私的绝对掌控。

核心功能

多模型无缝热切换:突破单一供应商限制,内置支持超过 15 家主流大语言模型(LLM)API 的直接接入。涵盖 Anthropic 官方、DeepSeek、Kimi、智谱、百炼、豆包等云端接口,以及 Ollama、Claude Code Router 等本地与代理网关,用户可在开发过程中无需重启直接热切换底层模型。

可视化工具卡片与差异对比:将底层 CLI 工具调用(如 Read、Edit、Bash、WebFetch 等)转化为内联的可视化卡片,提供带有语法高亮的代码差异对比(Diffs)、结构化输出预览与一键复制功能。

全局会话管理与回放:提供类似浏览器历史记录的运行记录系统,支持从任意节点恢复、分叉(Fork)或完全回放过往的 AI 对话。内置“Rewind”机制,允许开发者对文件更改进行检查点保存与带有试运行预览的本地回滚。

深度工作流定制与 MCP 集成:集成文件资源管理器、内存编辑器(专为

CLAUDE.md等项目级记忆文件设计)、Agent 规则可视化编辑器,并原生支持通过 MCP(Model Context Protocol)接入和管理外部工具与技能插件。权限审计与资源监控看板:具备精细化的本地与项目级 CLI 执行权限控制规则(支持批量 Allow/Deny)。内置详尽的数据看板,提供 Token 消耗细分统计、API 成本追踪、每日编码热力图与子代理任务流监控。

适用人群

重度依赖 AI 辅助编程系统(如 Claude Code)的全栈或前端/后端开发工程师。

需要频繁在不同大模型(如 DeepSeek 与 Claude 3.5 Sonnet)之间切换,比对代码生成质量的 AI 研究员与极客。

对代码安全具有极高要求,必须将项目上下文与配置数据完全存留于本地设备的企业级开发者。

优缺点分析

优点:

纯粹的隐私与隔离架构:彻底抛弃云端存储依赖,没有隐式的云端同步或数据库连接,所有设置、历史会话与运行日志均以扁平文件形式透明保存在本地

~/.opencovibe/目录下。现代化架构与低性能开销:采用 Rust 后端(Tauri v2)结合 Svelte 5 静态编译前端,保持了桌面端应用的轻量级体积,内存占用与启动速度显著优于基于 Electron 的同类工具。

极致的自动化设计:内置了类似于自动化测试循环的“Ralph Loop”无干预迭代模式,允许设定结束条件让 AI 自动修复代码直至通过,极大释放了开发者的双手。

缺点:

平台兼容性仍需打磨:目前该项目主要针对 macOS 进行迭代与深度测试,Windows 与 Linux 版本虽已提供基础支持,但在复杂环境兼容性和边缘稳定性上可能仍存在部分盲区。

上手配置门槛偏高:为了发挥完全体实力,用户仍需具备一定的 CLI 概念,并需自行申请、配置各家模型平台的 API Key 或部署本地模型服务,对零技术背景的用户存在陡峭的学习曲线。

系统要求

macOS:原生支持 Apple Silicon (M系列芯片) 及 Intel 架构设备,系统需 macOS 11.0 或更高版本(提供开箱即用的

.dmg镜像)。Windows / Linux:现阶段需依赖 Node.js (>= 20) 及 Rust 编译环境(>= 1.75)通过源码自行拉取与构建。

硬件建议:作为交互套壳软件,本身资源占用极低(双核 CPU / 4GB RAM 即可流畅运行);但若需接入 Ollama 运行本地代码大模型(如 Qwen2.5-Coder),建议配备至少 16GB 以上内存及支持 CUDA/Metal 硬件加速的独立显卡。

下载地址

声明:本站为非盈利性技术交流平台。所有资源均来自互联网或官方发布,版权归原作者所有。如有侵犯您的权益,请联系我们(fzxzcopy@163.com),我们将第一时间处理。