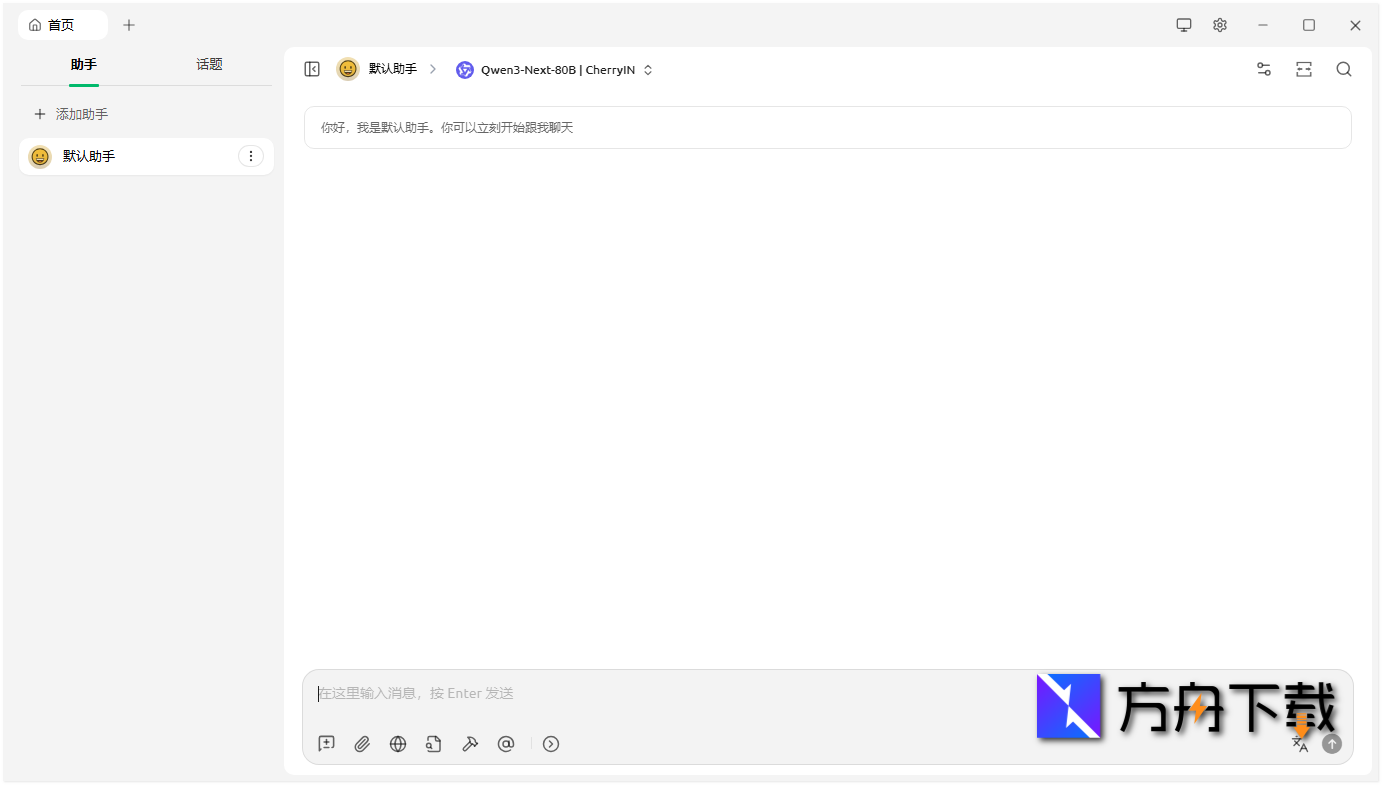

软件截图

软件介绍

Cherry Studio 是一款开源、跨平台的桌面级 AI 生产力工具,旨在为用户提供一个统一的界面来管理和交互各种大语言模型(LLM)。它打破了不同 AI 服务商之间的壁垒,允许用户在同一个可执行程序中同时调用 OpenAI、Anthropic (Claude)、Google (Gemini) 以及硅基流动等云端 API,同时也无缝支持 Ollama 和 LM Studio 等本地运行的私有模型。通过优雅的界面设计和强大的功能集成,Cherry Studio 将碎片化的 AI 工具整合为高效的工作流引擎,让用户能够开箱即用,专注于创造而非环境配置。

核心功能

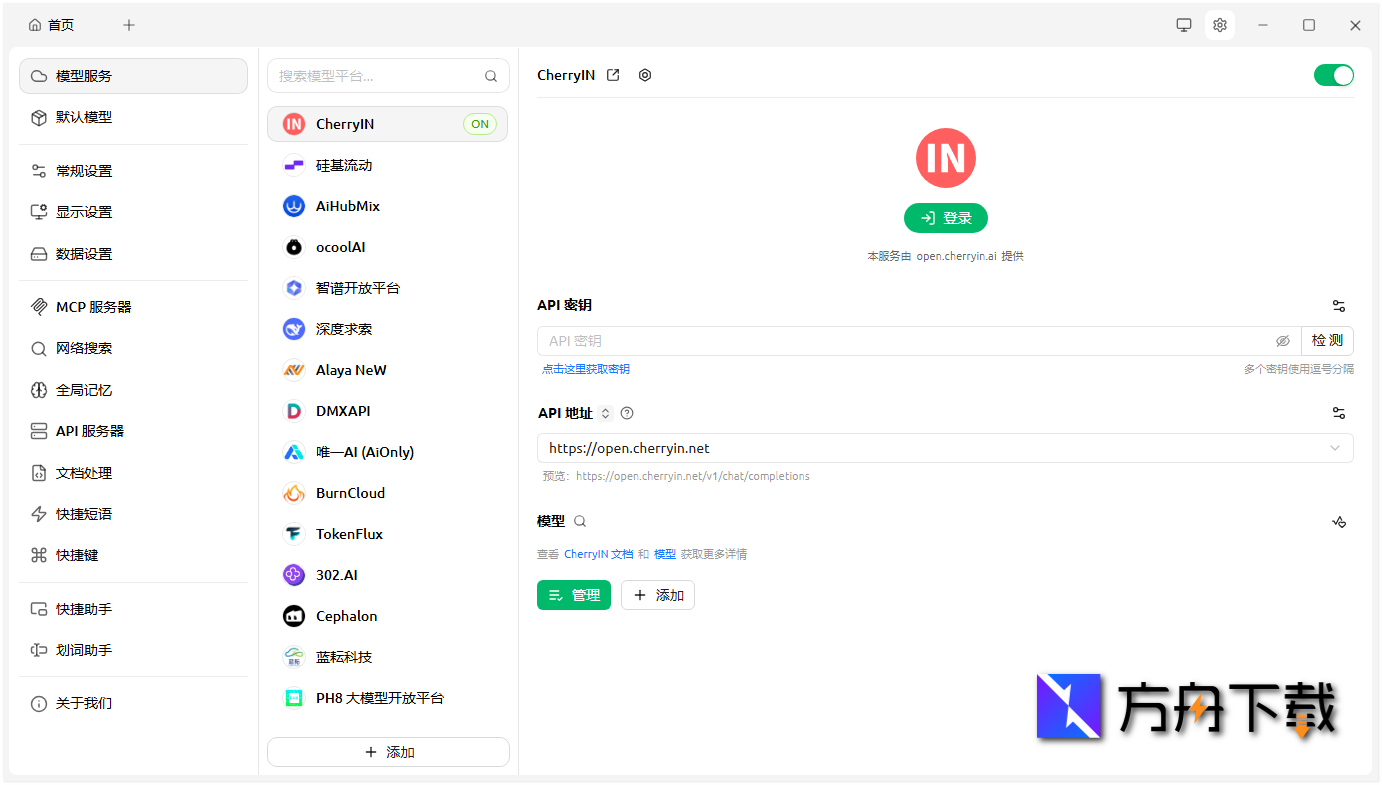

全能模型聚合:不仅支持接入 OpenAI、Gemini、Anthropic 等主流云服务商的 API,还兼容 Claude、Perplexity 等 Web 服务,更支持通过 Ollama 连接本地部署的隐私模型,实现“云端+本地”混合调用。

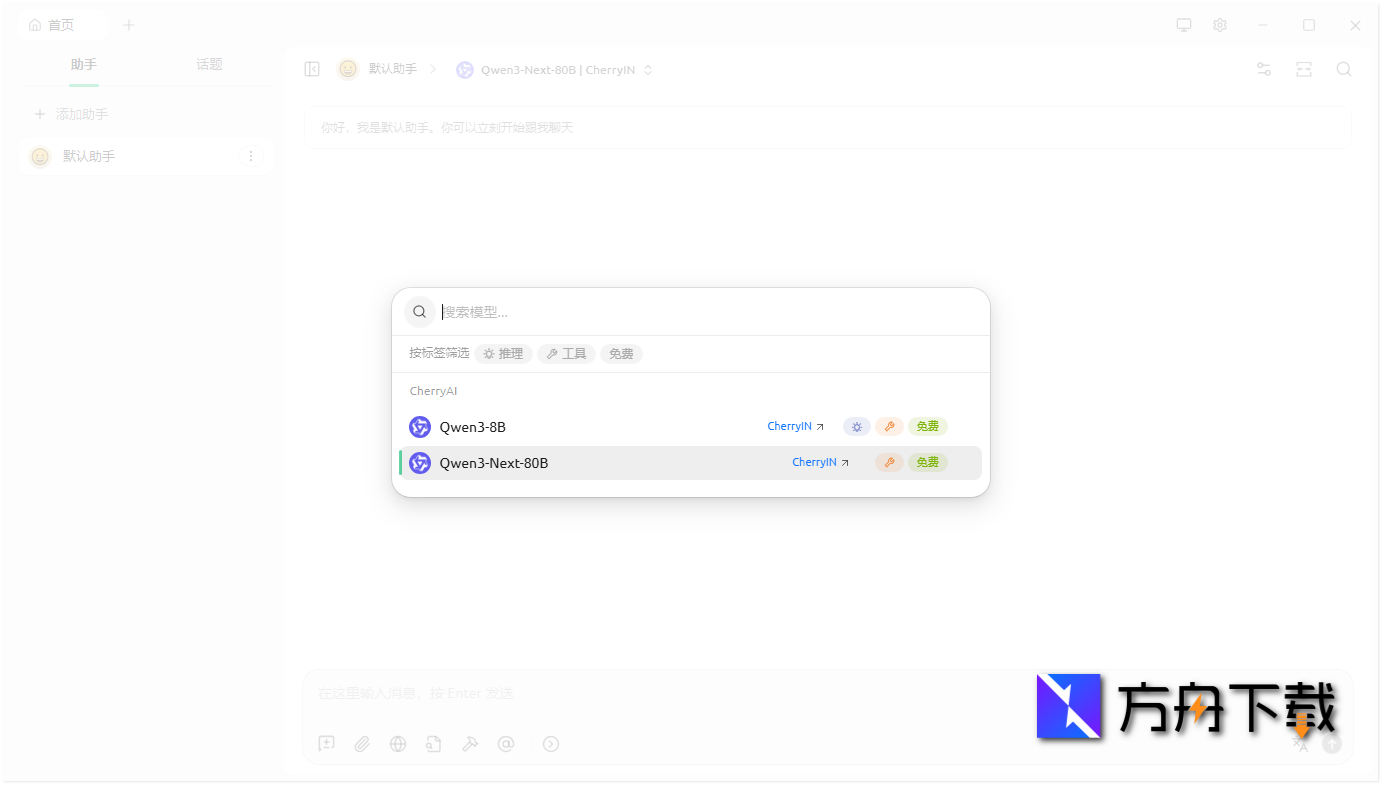

智能助手生态:内置超过 300 个预配置的 AI 智能助手,覆盖编程、写作、翻译等场景。用户可创建自定义助手,并支持多模型同时对话,便于对比不同模型的输出质量。

本地知识库与文档处理:支持导入 PDF、Office 文档、图片及纯文本文件,构建本地知识库。配合 RAG(检索增强生成)技术,让 AI 基于私有数据进行精准问答。

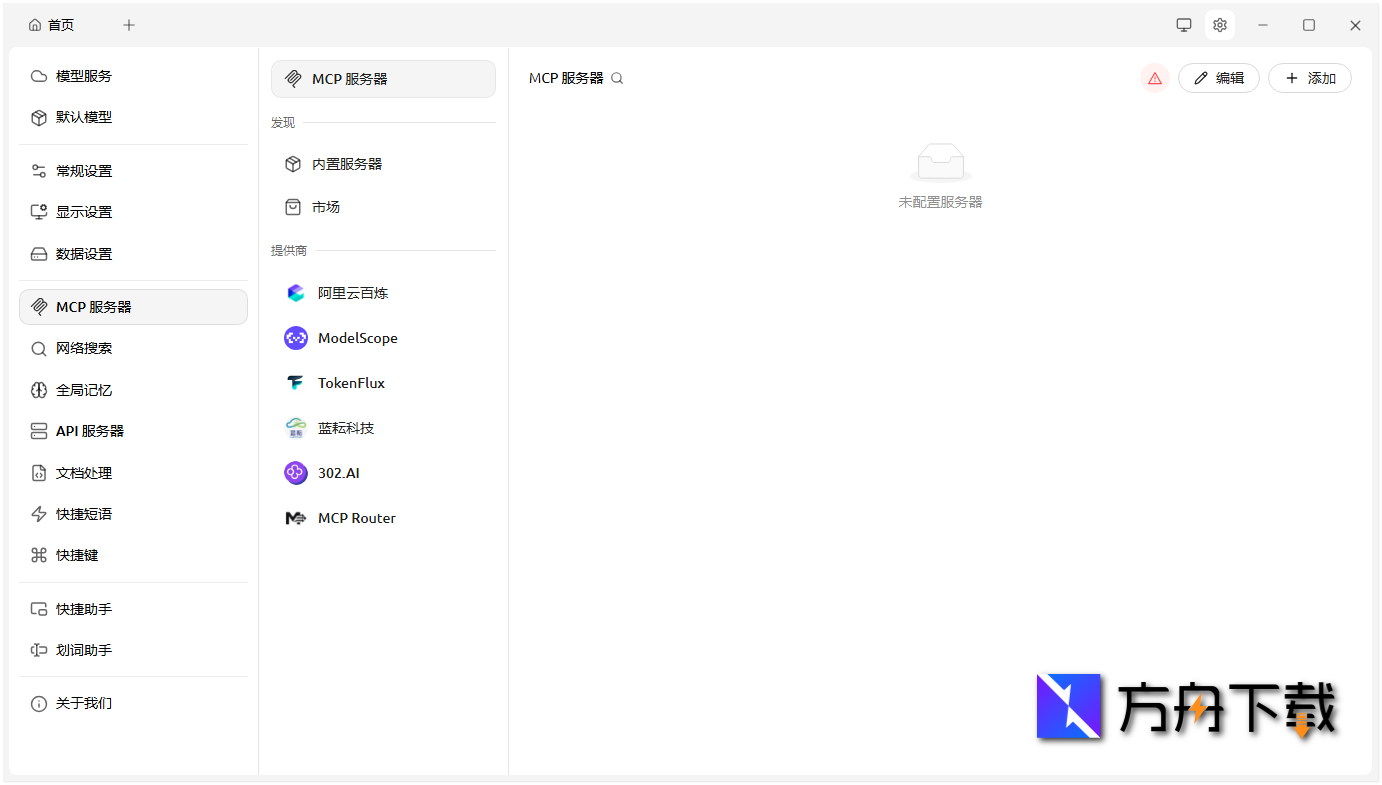

MCP 协议支持:率先集成 Model Context Protocol (MCP),允许 AI 模型安全地访问本地上下文或外部工具,扩展了 AI 与操作系统交互的能力。

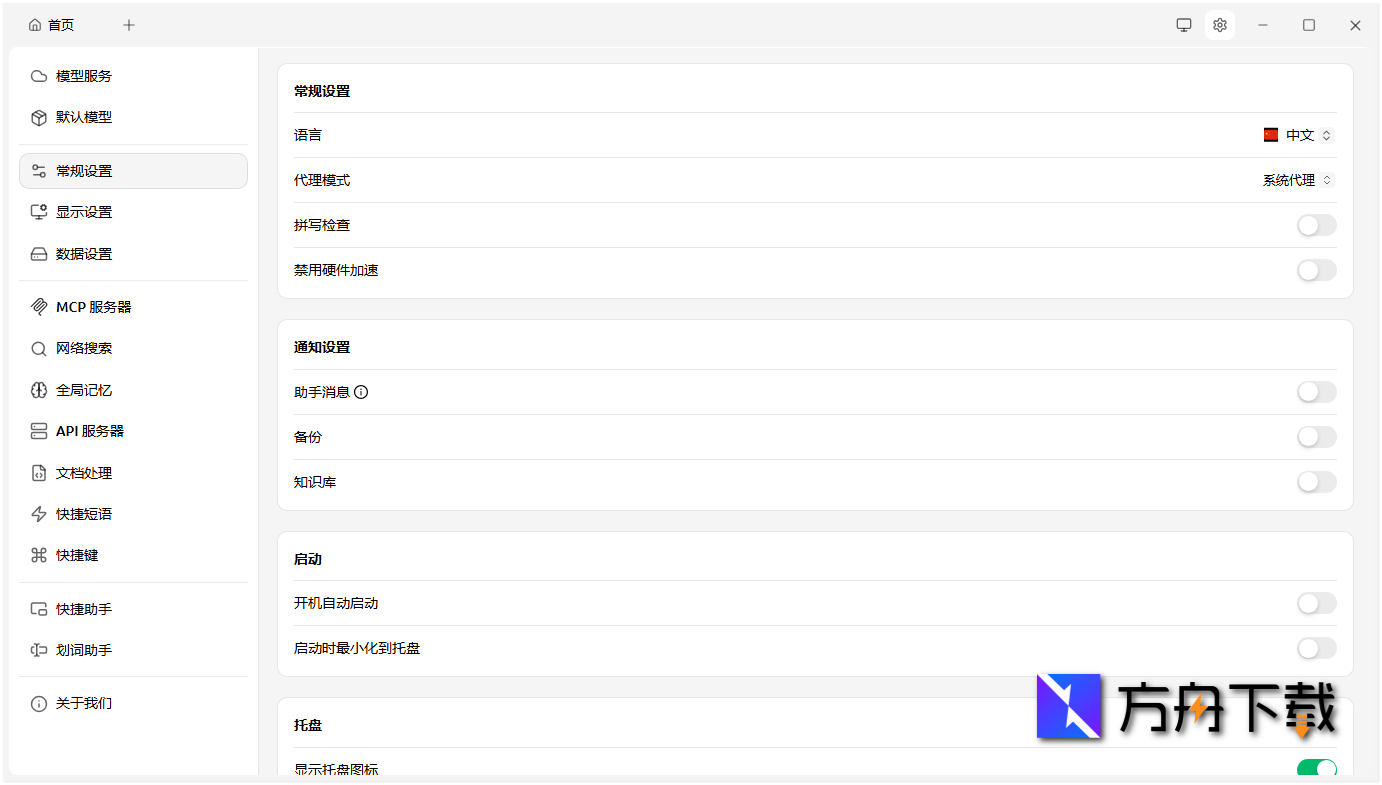

数据安全与同步:所有配置和对话记录优先本地存储,支持通过 WebDAV 协议进行多端加密备份与同步,确保数据掌控在用户手中。

适用人群

需要频繁切换使用不同 AI 模型(如 GPT-4, Claude 3.5, DeepSeek)的开发者与研究人员。

注重隐私保护,偏好使用 Ollama 等本地模型运行环境的技术极客。

通过 AI 进行文档分析、长文本写作或代码辅助的重度知识工作者。

寻求替代浏览器 Web 端,希望拥有更流畅、原生体验的桌面用户。

优缺点分析

优点:

极致的集成度:将市面上几乎所有主流的 LLM 服务整合在一个应用中,极大地减少了在不同网页和应用间切换的成本。

隐私与安全:开源透明,且支持完全离线的本地模型和 WebDAV 私有云同步,有效缓解了数据泄露的顾虑。

功能深度:支持 Mermaid 图表渲染、代码高亮、全局搜索以及 MCP 协议,功能深度远超普通的“套壳”客户端。

缺点:

配置门槛:虽然宣称开箱即用,但要发挥其全部威力(如配置 API Key、搭建本地 Ollama 环境、WebDAV 设置),仍需要一定的技术背景。

API 成本:软件本身免费,但调用商业模型的 API(如 GPT-4)需要用户自行承担费用,对于高频用户而言成本可能高于包月制 Web 服务。

Web 服务依赖:集成的第三方 Web 服务(如网页版 Claude)可能受限于对方平台的反爬策略,稳定性不如官方 API。

系统要求

Windows:Windows 10 或 Windows 11 (64-bit)

macOS:macOS 10.15+ (支持 Intel 及 Apple Silicon 芯片)

Linux:主流发行版(如 Ubuntu, Debian, Fedora),提供 AppImage 等格式

硬件建议:

若仅使用云端 API:任意主流配置即可流畅运行。

若运行本地模型(Ollama):建议至少配备 16GB RAM,推荐拥有 8GB 以上显存的 NVIDIA 显卡或 M 系列芯片 Mac。

下载地址

声明:本站为非盈利性技术交流平台。所有资源均来自互联网或官方发布,版权归原作者所有。如有侵犯您的权益,请联系我们(fzxzcopy@163.com),我们将第一时间处理。