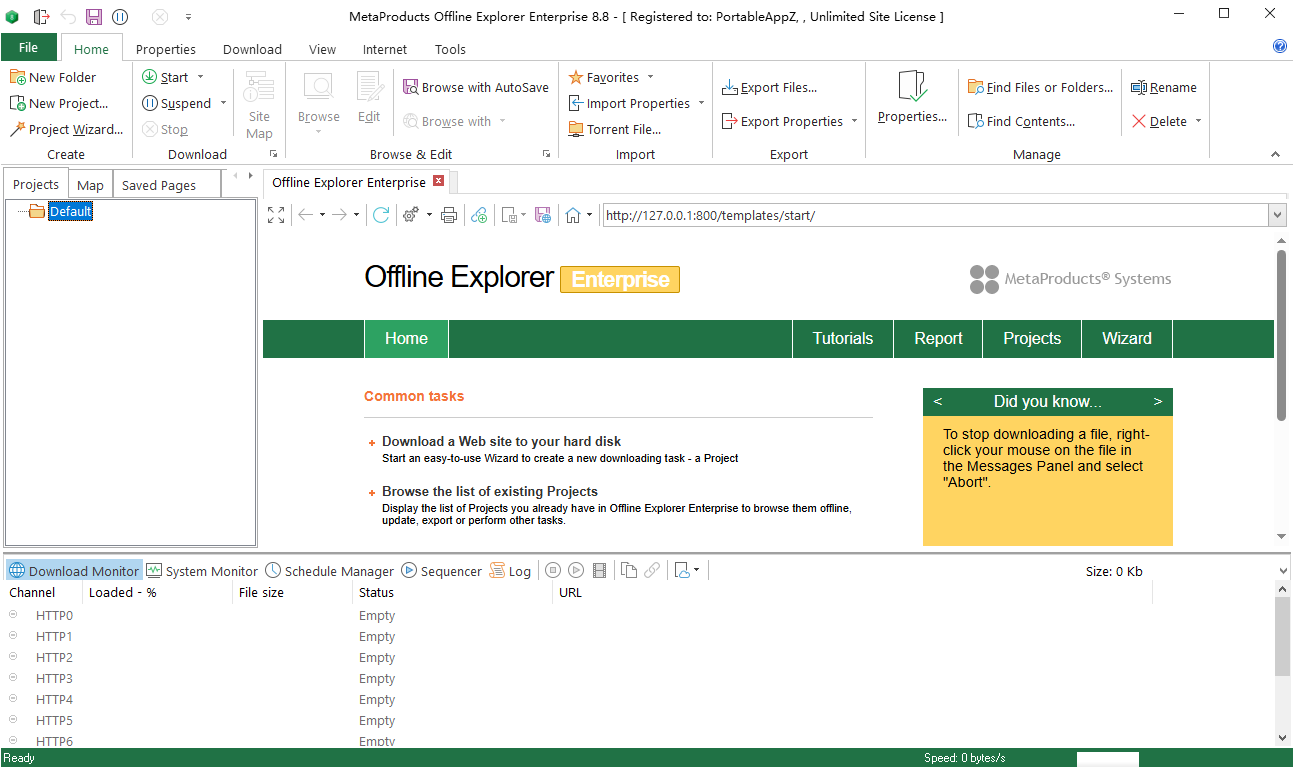

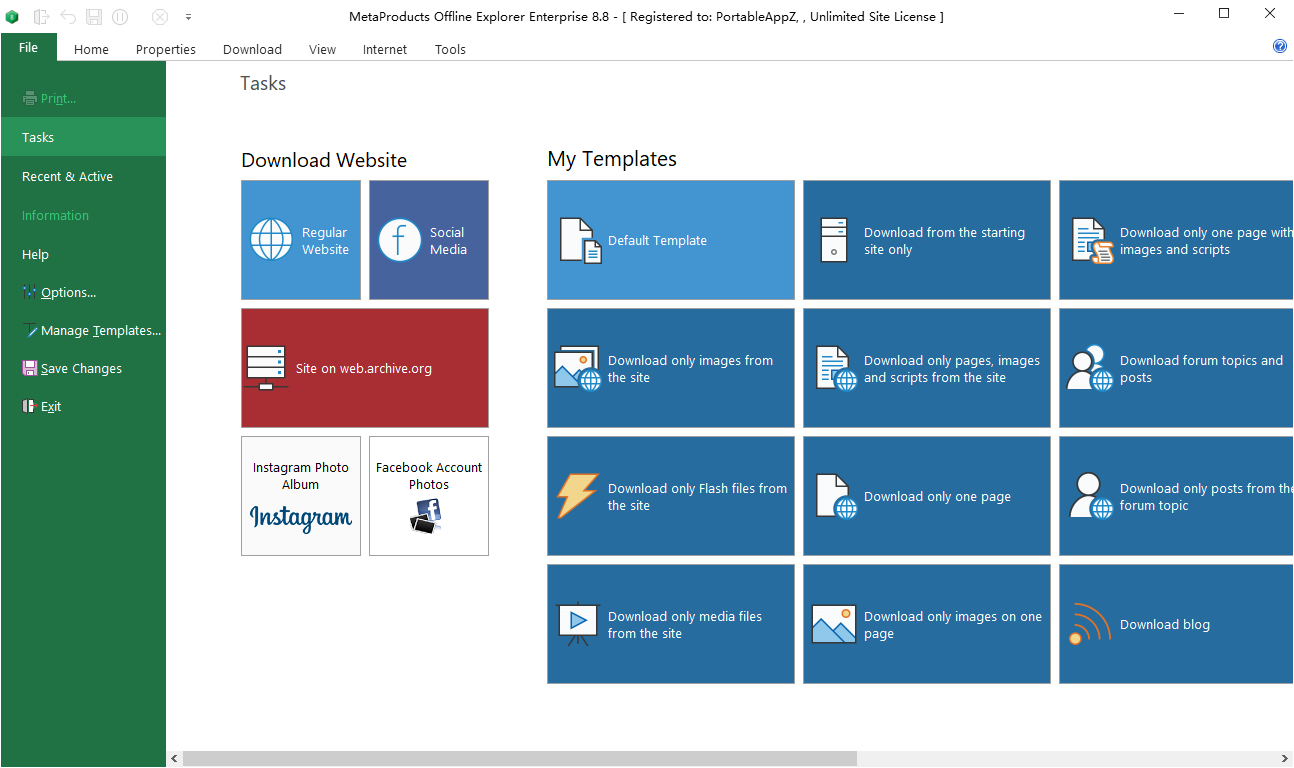

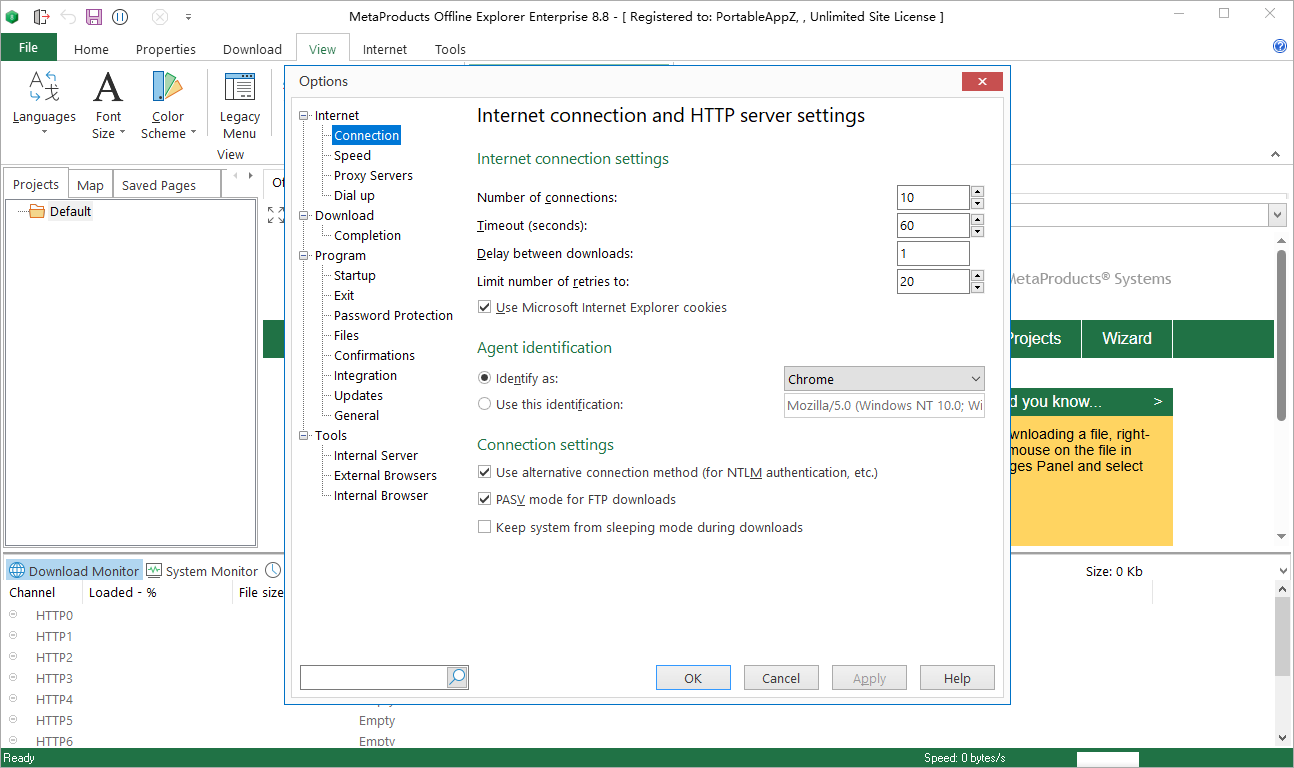

软件截图

软件介绍

Offline Explorer 是一款运行于 Windows 操作系统平台的老牌离线浏览工具。其核心设计理念在于帮助用户将互联网站点上的内容(包括 HTML 页面、图片、多媒体文件等)批量下载并存储到本地磁盘中,从而实现完全脱离网络环境的网页查阅。作为一款专业的网页抓取软件,它不仅提供了基础的页面保存功能,还融合了高度自定义的抓取规则配置,满足了数据采集、资料存档以及网络连接受限场景下的离线阅读需求。

核心功能

灵活的抓取与过滤机制:支持高度自定义抓取时间、下载深度以及内容筛选。用户可通过设置过滤器决定仅下载特定格式的文件(如仅抓取图片或文本),有效节省带宽和磁盘空间。

多模式浏览引擎:软件配置了内置的浏览程序,允许用户直接在软件内部查看已下载的离线页面;同时支持调用外部默认浏览器(如 Chrome、Edge)进行查看,并提供便捷的全浏览窗口切换功能。

网站结构映射 (Site Map):具备强大的站点分析能力,提供网站 MAP 视图,以直观的树状目录结构显示网站的层级与页面间的链接关系,方便开发者或研究人员理清网站架构。

全面的网络与存储管理:支持基础网络协议及代理服务器设置,适应复杂的企业网络环境。内置下载队列管理系统,并允许用户设定文件存储路径及磁盘空间限制,防止抓取过程耗尽本地资源。

数据导出支持:具备基础的数据导出功能,支持将离线保存的常规文件类型和站点结构信息导出,便于进行二次处理或分享。

适用人群

科研人员与学术工作者:需要批量下载并长期存档在线文献、参考资料库,以备在无网环境下随时查阅。

数据分析师与前端开发者:需要分析目标网站的目录结构、链接关系及静态资源分布的专业技术人员。

经常处于弱网或无网环境的用户:如差旅人士、户外工作者,需提前将资讯或教程站点下载至本地。

SEO 从业者:用于抓取和分析竞品网站的页面层级与资源调用情况。

优缺点分析

优点:

功能深度高:抓取规则颗粒度极细,代理设置、磁盘配额、文件类型过滤等功能一应俱全,满足极客与专业用户的定制化需求。

结构可视化:网站 MAP 功能不仅是下载工具,更是极佳的站点结构逆向分析利器。

稳定性强:作为一款成熟的离线浏览器,其底层抓取逻辑和下载队列管理非常稳健,适合应对结构复杂的中大型站点。

缺点:

学习门槛:高级过滤规则和抓取深度的配置较为复杂,对缺乏网络协议基础的新手用户不太友好。

动态页面解析限制:对于现代基于大量 JavaScript 渲染的 SPA(单页应用)站点或强反爬机制的网站,抓取效果可能受限,需要配合更复杂的脚本或环境。

系统要求

操作系统:Windows 7 / 8 / 10 / 11 (包含 32-bit 与 64-bit 版本)

处理器:1 GHz 或更快的 x86/x64 架构处理器

内存:建议 1 GB RAM 及以上(抓取大型站点时建议配备更多内存以处理庞大的链接队列)

硬盘空间:软件本身占用空间极小(约 50MB 以内),但需根据计划下载的网站规模准备充足的存储空间。

网络:支持常规宽带连接,适配 HTTP/HTTPS/FTP 等基础协议。

下载地址

声明:本站为非盈利性技术交流平台。所有资源均来自互联网或官方发布,版权归原作者所有。如有侵犯您的权益,请联系我们(fzxzcopy@163.com),我们将第一时间处理。