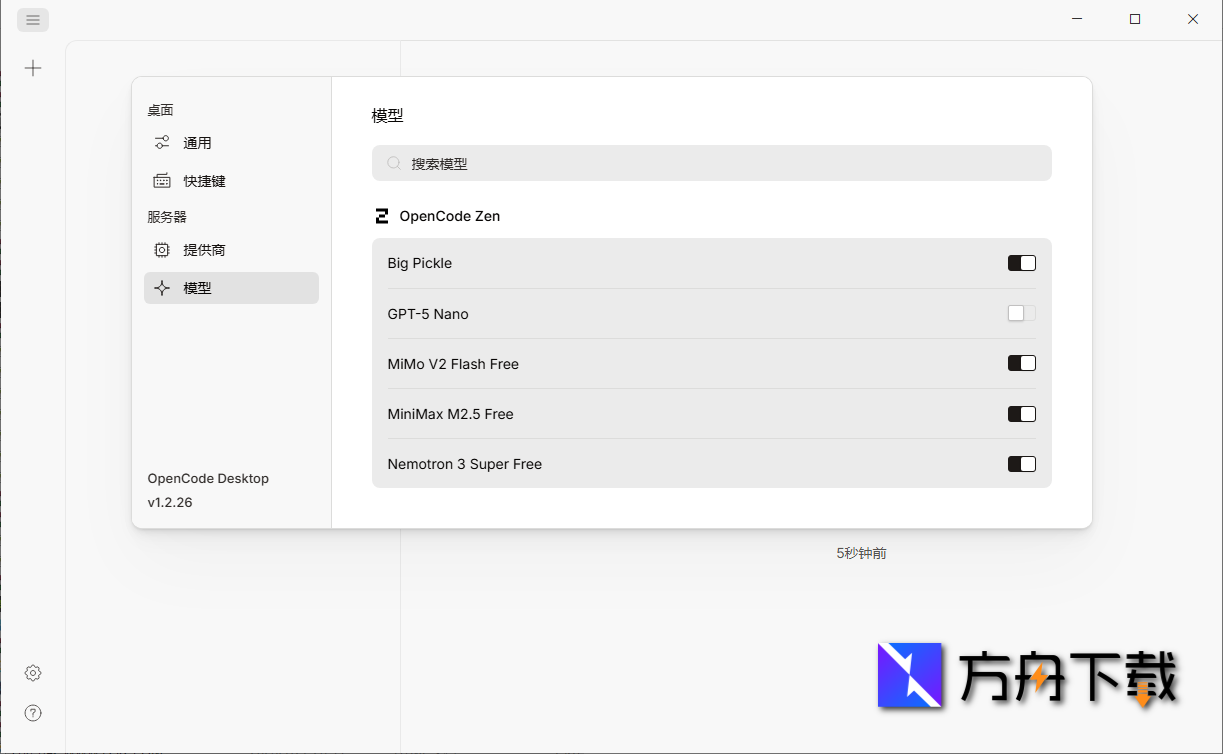

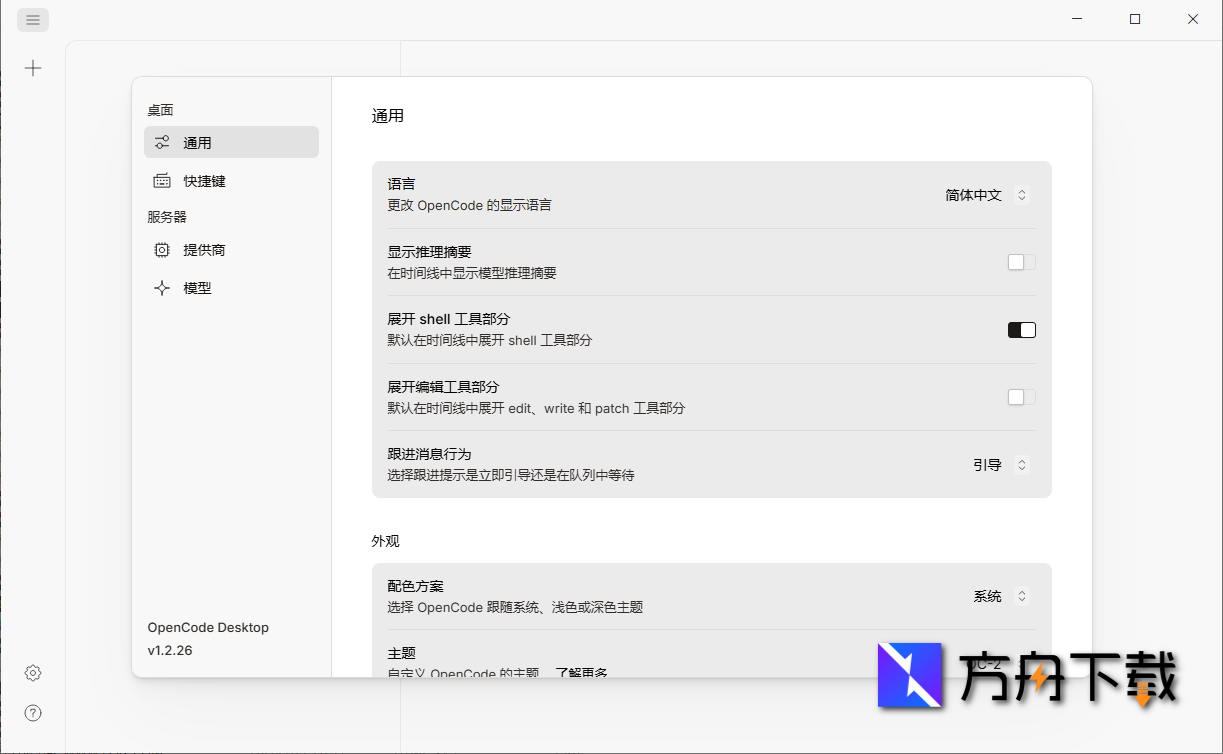

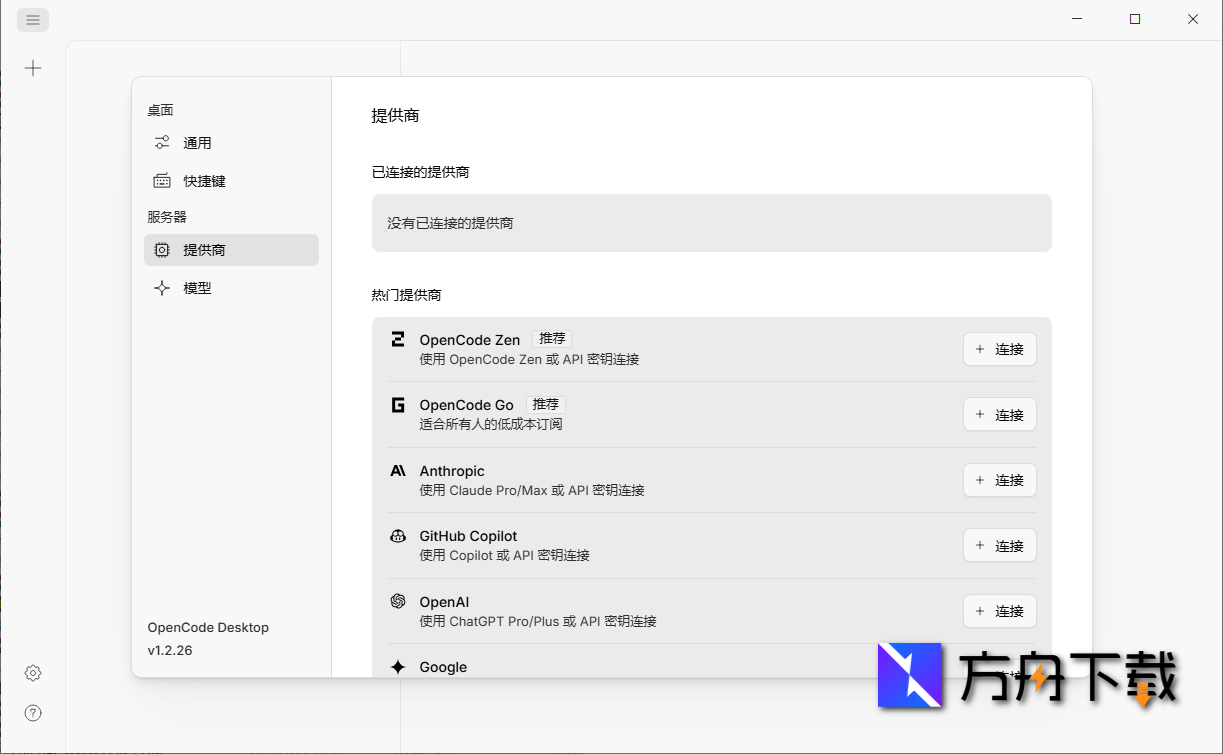

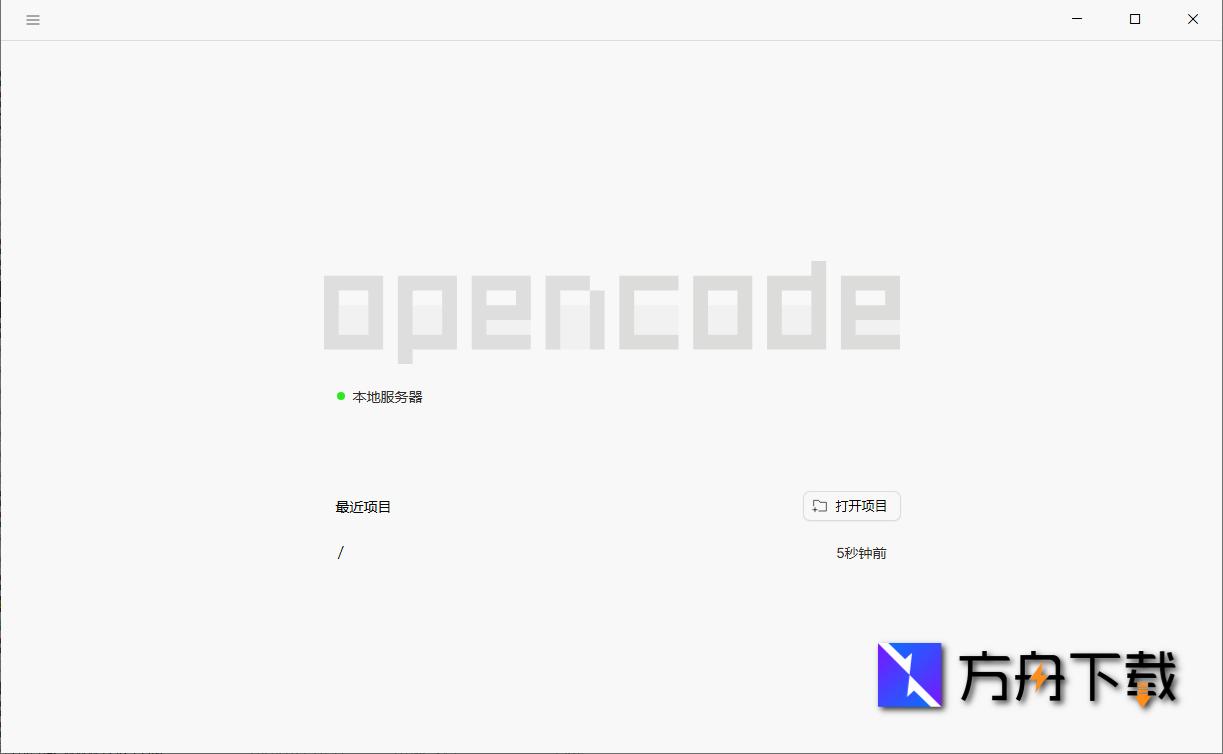

软件截图

软件介绍

OpenCode 是一款备受瞩目的开源AI编程智能体(在 GitHub 上斩获超 12 万 Star),其核心交互围绕终端控制台(TUI)构建。不同于传统的 GUI 插件代码助手,OpenCode 在设计理念上充分考虑了终端重度用户的需求,由多位 Neovim 重度使用者与 Terminal.shop 创始人联合打造。作为一款理想的替代ClaudeCode开源方案,它采用了纯正的 Client/Server(C/S)架构,使得前端交互与底层 AI 推理服务严格解耦。这种架构赋予了 OpenCode 极其灵活的运行方式——它既可以作为轻量级的命令行代码助手在本地机器独立运行,也具备支持未来移动端 App 远程驱动的结构潜力。同时,它的模型层被设计为完全提供商无关(Provider-Agnostic),用户可以在云端模型(如 OpenAI、Claude、Google)与本地私有化模型之间无缝衔接。

核心功能

多模型/去中心化推理机制:拒绝被单一厂商锁定,默认支持自定义接入各类模型,实现本地大模型辅助编程或调用第三方高性能云端接口,确保数据隐私与成本控制的平衡。

多态化内置 Agent (智能体):

build:拥有全量访问权限的默认核心 Agent,负责编写新代码、读取文件和执行构建指令。

plan:安全受限的规划 Agent。它被剥夺了默认的文件修改权限,每次执行 Bash 命令前均涉及人工审批流程,专攻代码库的阅读溯源与重构规划。

general:子智能体,由系统内部调度处理高复杂度的“多步搜索”(Multi-step)与综合性技术验证。

开箱即用的 LSP 支持:突破了传统 CLI 提示词缺乏深度的痛点,原生集成 Language Server Protocol (语言服务器协议),通过代码 AST 与项目上下文分析实现工程级别的精准推导。

跨环境部署与热切换:通过 C/S 结构分离控制流和执行流,用户仅需

Tab键即可在同一终端视窗无缝切换多种 Agent 身份继续对话和开发动作。

适用人群

终端极客开发者:Neovim/Vim、Tmux 或纯命令行高频使用者。

关注数据合规的高级工程师:需要将代码通过完全私有化的跨端AI开发助手进行隔离处理,防范商业代码外泄。

架构师与代码审查员:常常接手陌生大型工程(Legacy Code),需要利用 Plan 模式对超大规模仓库进行静态理解及结构化梳理的人群。

优缺点分析

优点:

生态中立性极佳:百分百拥抱开源,不与任一独家闭源的 LLM 服务供应商发生强绑定,抗平台退化风险高。

终端交互深度融合:其自研的 TUI 系统表现优异,充分调动键盘快捷键能力,对有 CLI 肌肉记忆的开发者而言是纯粹的工作流增强。

防破坏机制:专门将 "plan" 工具剥离为独立的只读模式,有效隔绝 AI 在执行复杂探索时意外污染工作目录的安全隐患。

缺点:

交互学习成本:纯终端编码工具的学习曲线高于点击为主的 GUI 工具(例如 Cursor 或 VS Code 的 Copilot)。

GUI客户端处于早期阶段:虽然近期释出了 macOS/Windows 的图形桌面系统(Beta版),但其体验与稳定性尚不足以匹敌终端主战场的表现。

依赖大模型硬实力:自身作为框架层,对底层 LLM 的推理深度依赖极强;如果接入小参数量的本地模型,由于幻觉或指令遵从能力不足,可能会导致 Build/General 多步任务频繁崩溃。

系统要求

操作系统:支持 macOS (Apple Silicon 最佳 / Intel 亦可),Windows(通过 Scoop / Choco 部署),以及主流 Linux 发行版(如 Arch Linux 的 pacman/paru 库直接安装)。

运行环境底座:建议已安装 Node.js 生态管理工具(npm/bun/pnpm/yarn)或 Homebrew/Nix 等原生系统包管理器。

硬件配置建议:

云端大模型模式:本体资源开销极小,双核 CPU 及 2GB 剩余 RAM 即可流畅运行。

本地大模型模式:若配合 Ollama/vLLM 挂载本地模型作为后端,推荐采用具有 8GB 及以上独立显存的 GPU(如 RTX 3060 及以上级别)或 M 系列 16GB 以上统一内存架构的 Mac 机型,以保证 LSP 通信和模型生成不发生严重阻塞。

下载地址

声明:本站为非盈利性技术交流平台。所有资源均来自互联网或官方发布,版权归原作者所有。如有侵犯您的权益,请联系我们(fzxzcopy@163.com),我们将第一时间处理。