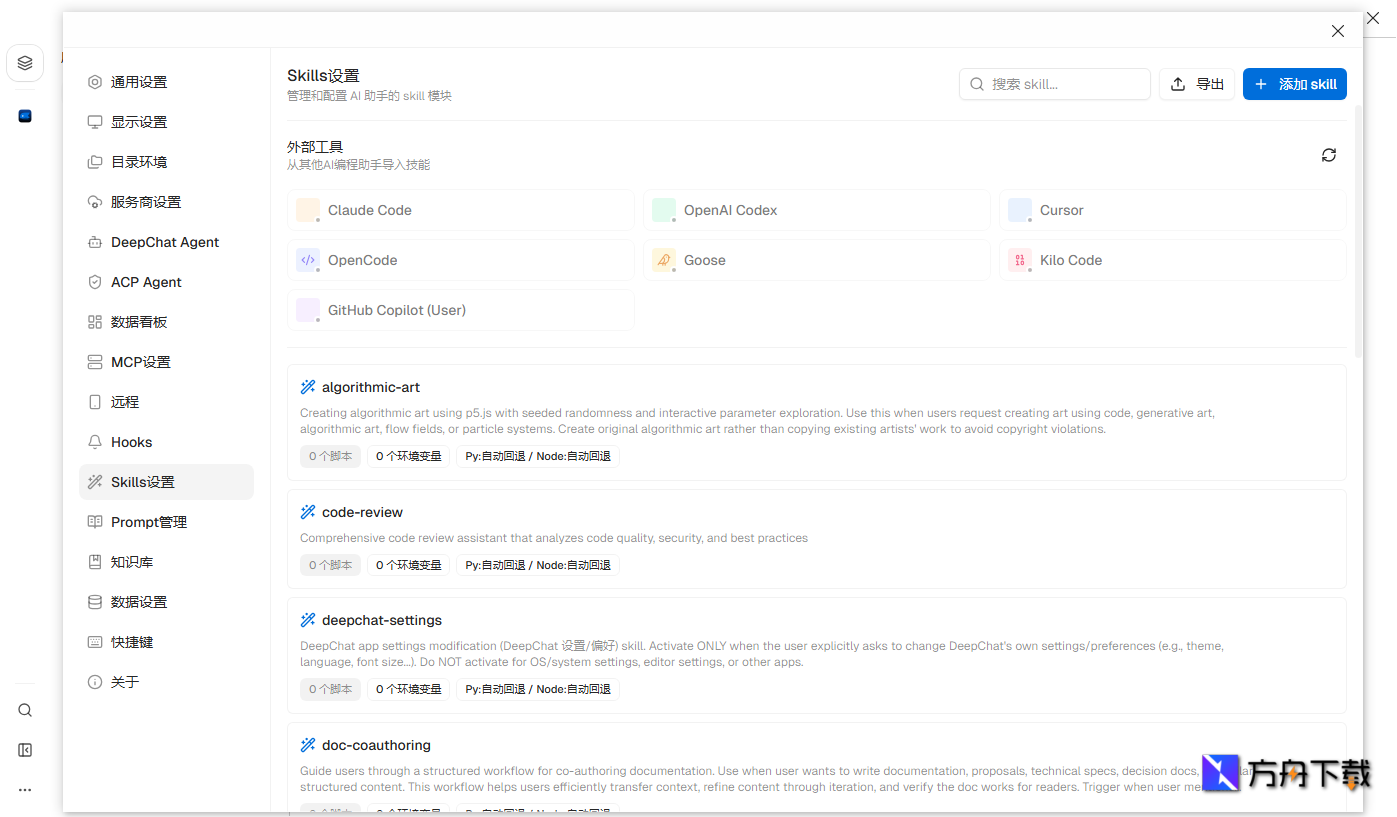

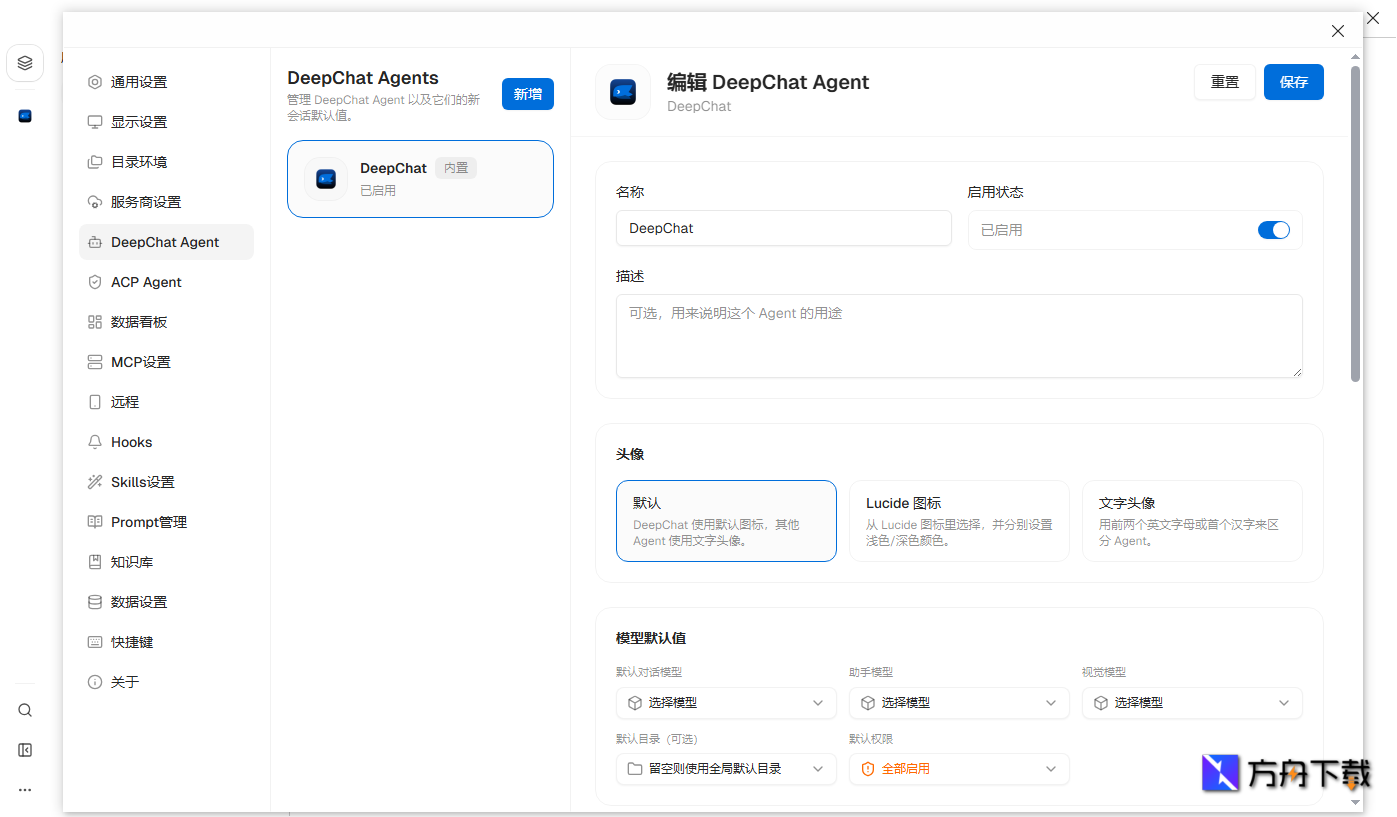

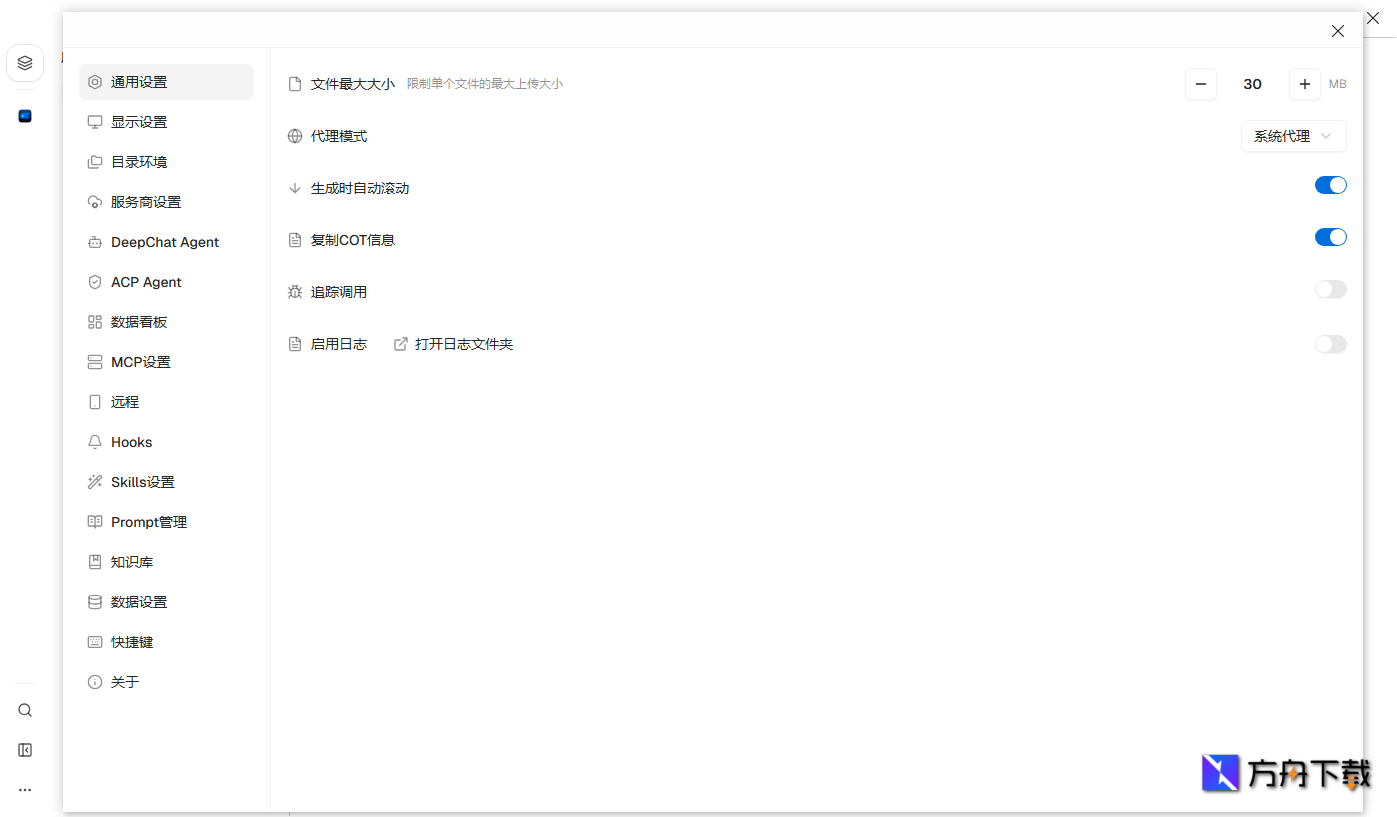

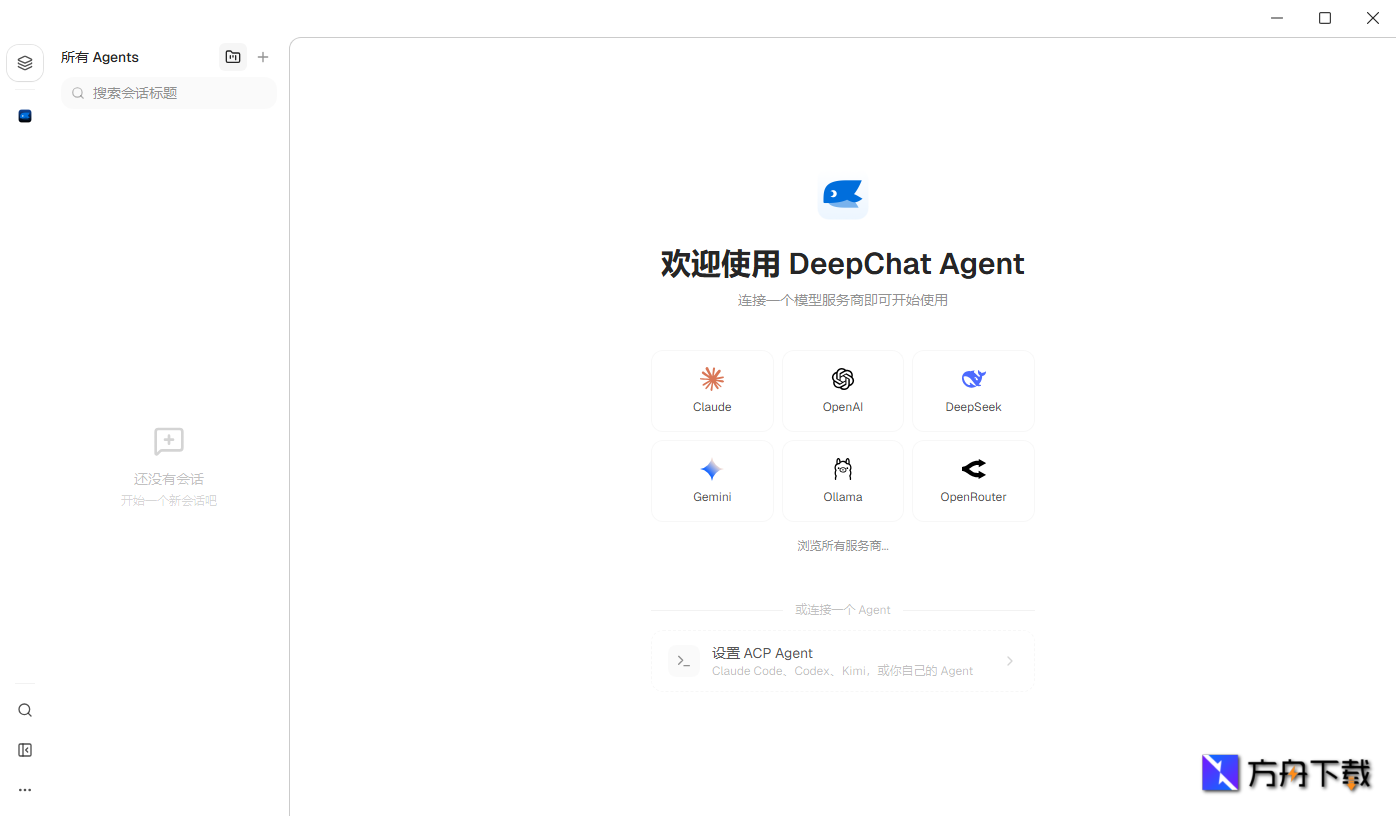

软件截图

软件介绍

DeepChat 是一款基于 Electron 架构构建的功能强大的开源多模型 AI Agent 桌面客户端。在当前大语言模型(LLM)生态极度繁荣却又各自为战的背景下,DeepChat 试图打造一个终极入口,统一云端 API(如 OpenAI、Anthropic、DeepSeek、Gemini)与本地化计算资源(如 Ollama)。更重要的是,它不仅停留在“对话框”层面,而是深入整合了 MCP(Model Context Protocol)和 ACP(Agent Client Protocol),使外部工具调用和 Agent 协作成为第一原生体验。无论是充当开发者的日常提效工具,还是极客玩家研究 AI 生态的测试沙盒,DeepChat 都展现出了极高的工程完整度。

核心功能

全景模型接入与本地聚合:原生支持包含 DeepSeek、OpenAI、Claude、Gemini 等在内的十余款主流公有云模型,并完美整合 Ollama 生态。用户无需复杂的命令行操作,即可通过图形界面直接管理并下载本地模型。

MCP 与 ACP 协议级融合:完整支持 MCP 的 Resources/Prompts/Tools 三大特性,内置 Node.js 运行环境可实现零配置代码执行。同时,它将 ACP Agent 作为“独立能力模型”接入,配合原生 Workspace UI 进行复杂的结构化交互与终端输出管理。

沉浸式非阻塞交互体验:采用多窗口加多 Tab 的混合视图架构,确保多会话之间的完全并行与无阻塞运行。同时,支持多分支对话记录与 Artifacts 结果沉浸式渲染,极大地降低了长文本排版的冗杂感。

强定制化搜索注入:内置直接调用博查等检索 API 的能力,同时支持模拟浏览器浏览主流公共搜索引擎,使得大模型在回答特定问题时,可挂载垂直维度的搜索引擎作为高信源参考。

适用人群

重度 AI 玩家与极客初学者:厌倦了多网页切换,希望一站式管理所有 AI API 资产与本地模型库的用户。

软件与系统开发人员:需高频进行代码生成、调试,且需要高度可定制的外部工具链(MCP/ACP)的开发者。

信息整合与内容创作者:需要多模型对照生成、Artifacts 排版以及实时互联网信息校验的工作者。

优缺点分析

优点:

极高的生态整合力:同类竞品很少有能在支持全面云端 API 的前提下,还将 MCP 的 Tool 支持做到如此深度的开箱即用。

体验流畅的 GUI 设计:没有沦为简单的 Web-view 网页套壳,原生交互做得很扎实,多窗口下的并行处理效率极高。

开源且极具商业包容性:基于 Apache 2.0 协议构建,代码结构高度解耦,便于企业在此框架上二次开发自己的安全终端。

缺点:

系统资源要求有一定门槛:尽管基于 Web 技术栈进行了重构优化,但要支撑复杂的 Artifacts 渲染以及庞大的模型配置矩阵,Electron 架构依然可能成为性能上的拖累点。

配置与安全边界学习成本:对于单纯想轻量聊天的用户来说,如此密集的专业名词(MCP、Ollama、ACP)以及 API Key 的获取流程稍显繁杂。

系统要求

由于 DeepChat 是一个支持各类调用以及内置运行环境的桌面端应用,以下为基础运行建议:

受支持操作系统:Windows 10/11 (64-bit),macOS 10.15+ (支持 Apple Silicon 与 Intel),主流 Linux 发行版(Debian/Ubuntu/AppImage 等)。

通用硬件建议:

云端调用模式:具备 4GB 以上的系统内存,稳定的互联网连接(可能需要代理)。

本地推理模式(如结合 Ollama):强烈建议 16GB 以上的系统内存及具备 8GB 以上显存(VRAM)的独立显卡,或者搭载 Apple M 系列芯片且统一内存为 16GB 以上的 Mac 设备。

下载地址

声明:本站为非盈利性技术交流平台。所有资源均来自互联网或官方发布,版权归原作者所有。如有侵犯您的权益,请联系我们(fzxzcopy@163.com),我们将第一时间处理。